이번에는 아나콘다를 이용하여 Yolo 객체 인식을 구현해 본다.

아무래도 클라우드 기반이다 보니 소스를 저장 및 공유하기도 편리한 점이 있으리라.

(비쥬얼 스튜디오 코드로 구현한 내용은 https://moontech.tistory.com/8 링크로 확인 가능하다.)

환경은 기존과 동일하고 IDE만 Anaconda로 변경되었다.

우선 아나콘다를 다운로드 받는다.

아래의 사이트를 방문하면 쉽게 설치가 가능하다.

https://www.anaconda.com/download

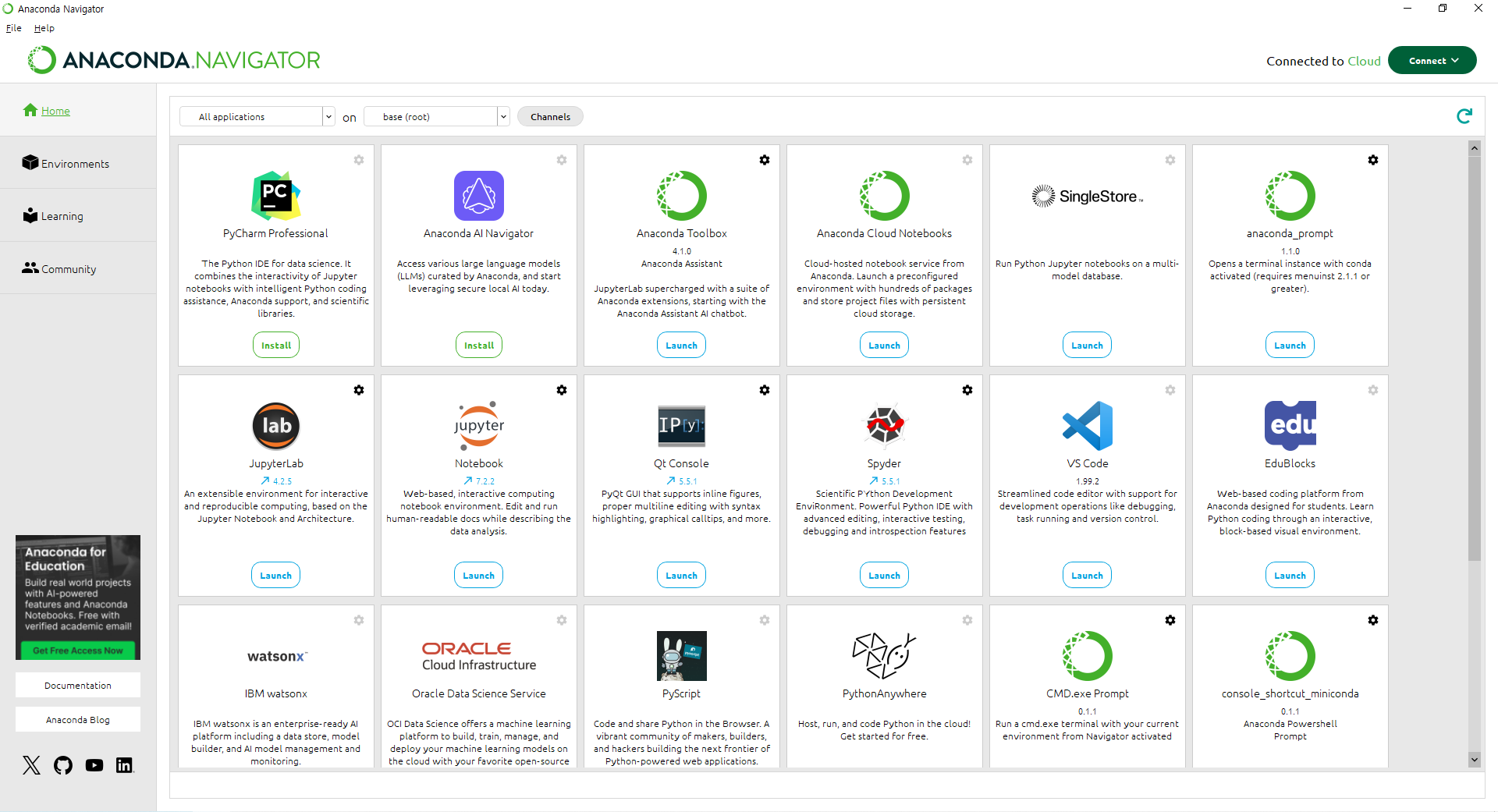

아나콘다를 설치하면 아래와 같은 그림을 볼 수 있다.

아래의 화면처럼 새로운 환경을 하나 만들어 준다.

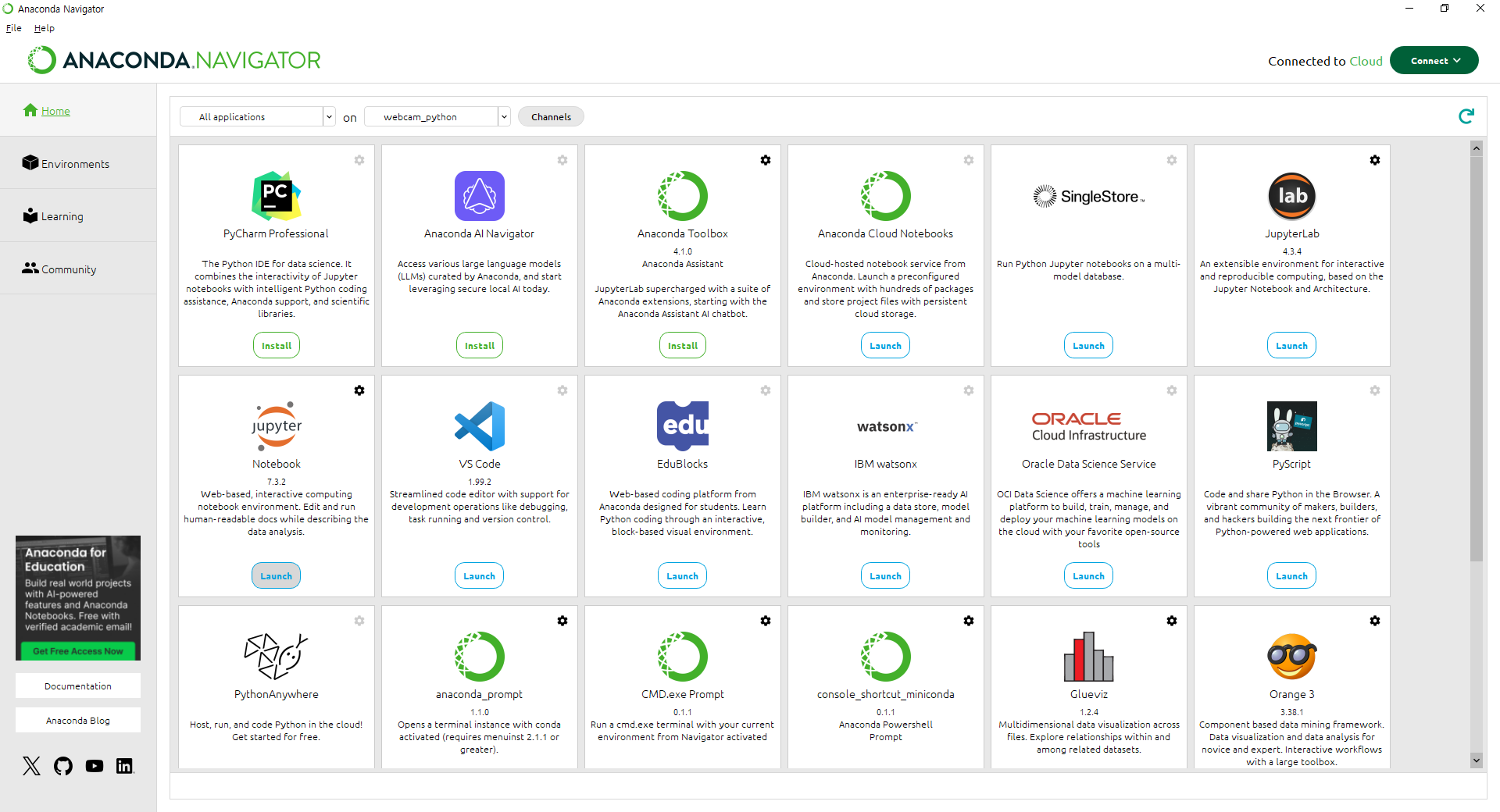

그 후 다시 Home 탭으로 이동하면

Jupyter Notebook이 설치되어 있을 것이다. 설치되어있지 않으면 Install을 하면 된다.

이후 Launch 버튼을 클릭한다.

아래와 같이 앱이 하나 추가되어있을 것이다.

해당 아이콘을 클릭하면 아래와 같은 cmd 창이 기동된다.

(때에 따라서는 관리자 모드로 창을 띄워야 할 수도 있음을 참고하자.)

cmd 창에 표시되는 url을 복사하여 브라우저에 붙여넣는다.

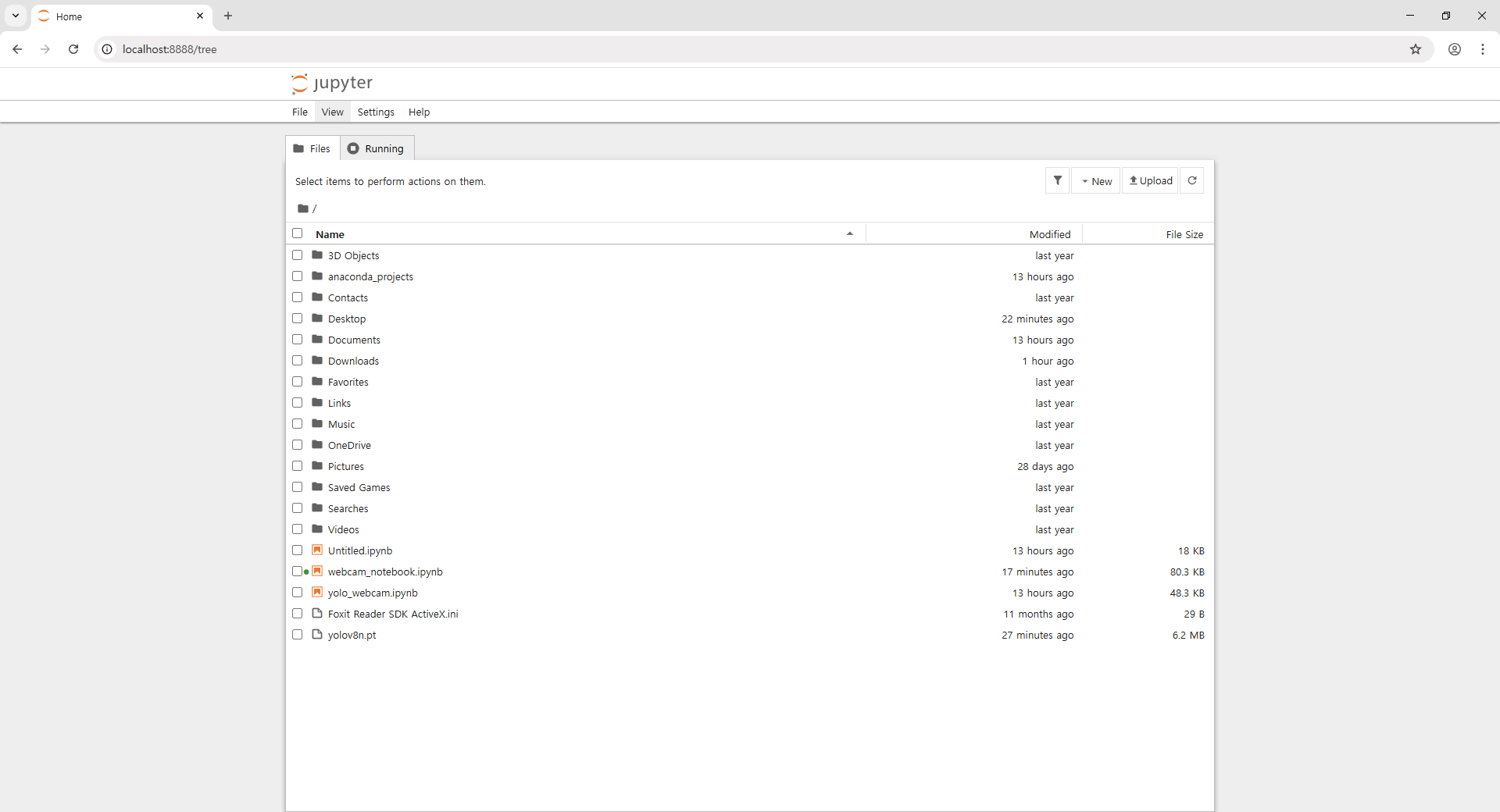

그러면 아래와 같은 브라우저 창을 볼 수 있다.

소스 코드는 다시한번 붙여보자면.. (물론 챗GPT에게 물어본 내용이다. ^0^)

# 🛠 설치 (한 번만)

# pip install ultralytics opencv-python

from ultralytics import YOLO

import cv2

# YOLO 모델 로드

model = YOLO("yolov8n.pt") # 사전 학습된 가장 가벼운 모델 사용

# 웹캠 열기 (0번 카메라)

cap = cv2.VideoCapture(0)

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# YOLO 추론

results = model.predict(source=frame, show=False, stream=True)

# 결과를 시각화하여 출력

for r in results:

annotated_frame = r.plot()

cv2.imshow("YOLOv8 - Webcam", annotated_frame)

if cv2.waitKey(1) & 0xFF == ord("q"):

break

cap.release()

cv2.destroyAllWindows()

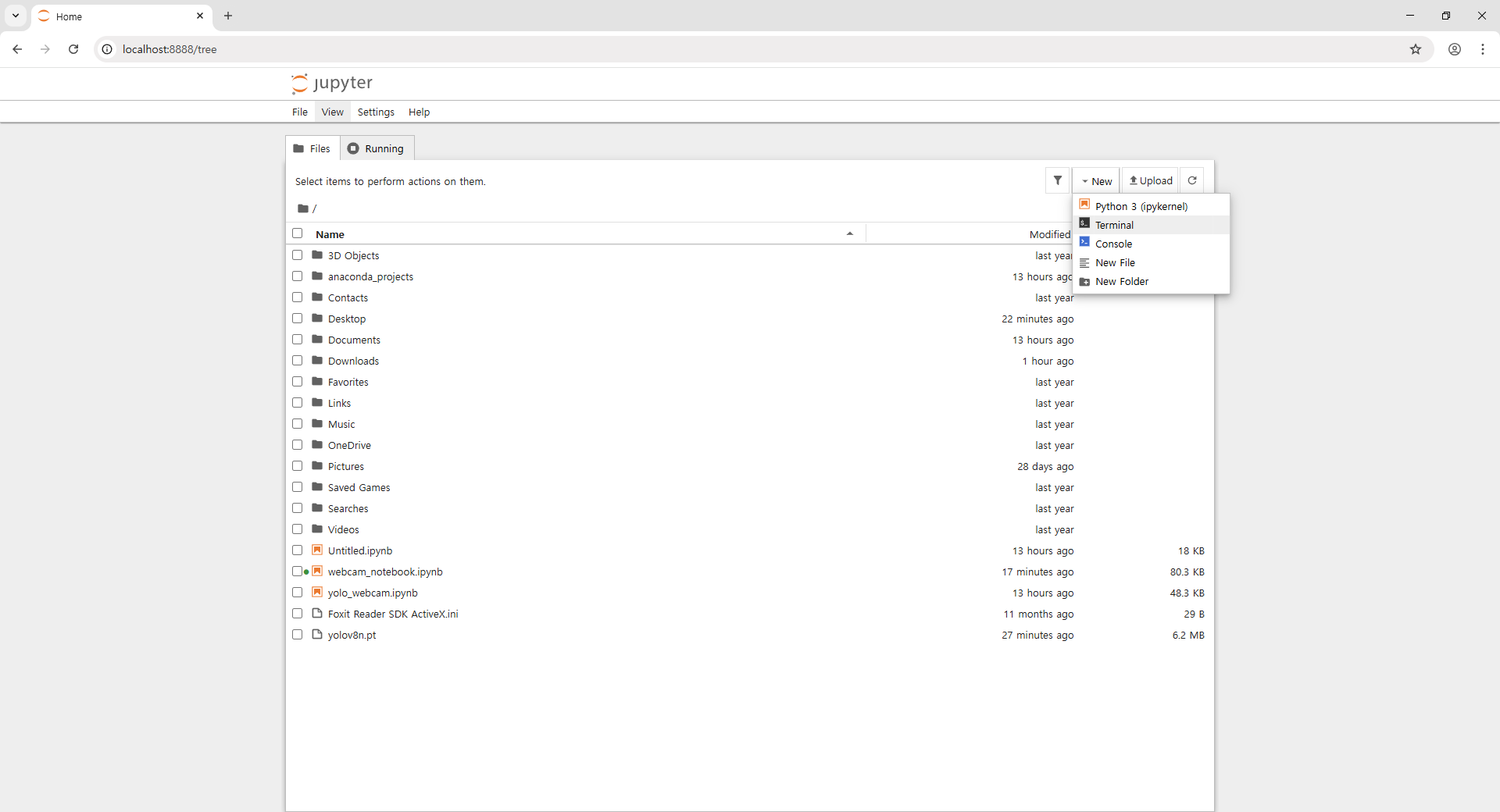

pip install ultralytics opencv-python 이 과정을 수행해야 하는데 아래의 화면처럼 터미널에서 수행해주면 된다.

참고로 프롬프트가 떨어질때까지 대기해 주어야 한다. 시간이 약간 소요된다.

이후 커널을 Python을 선택하면 된다.

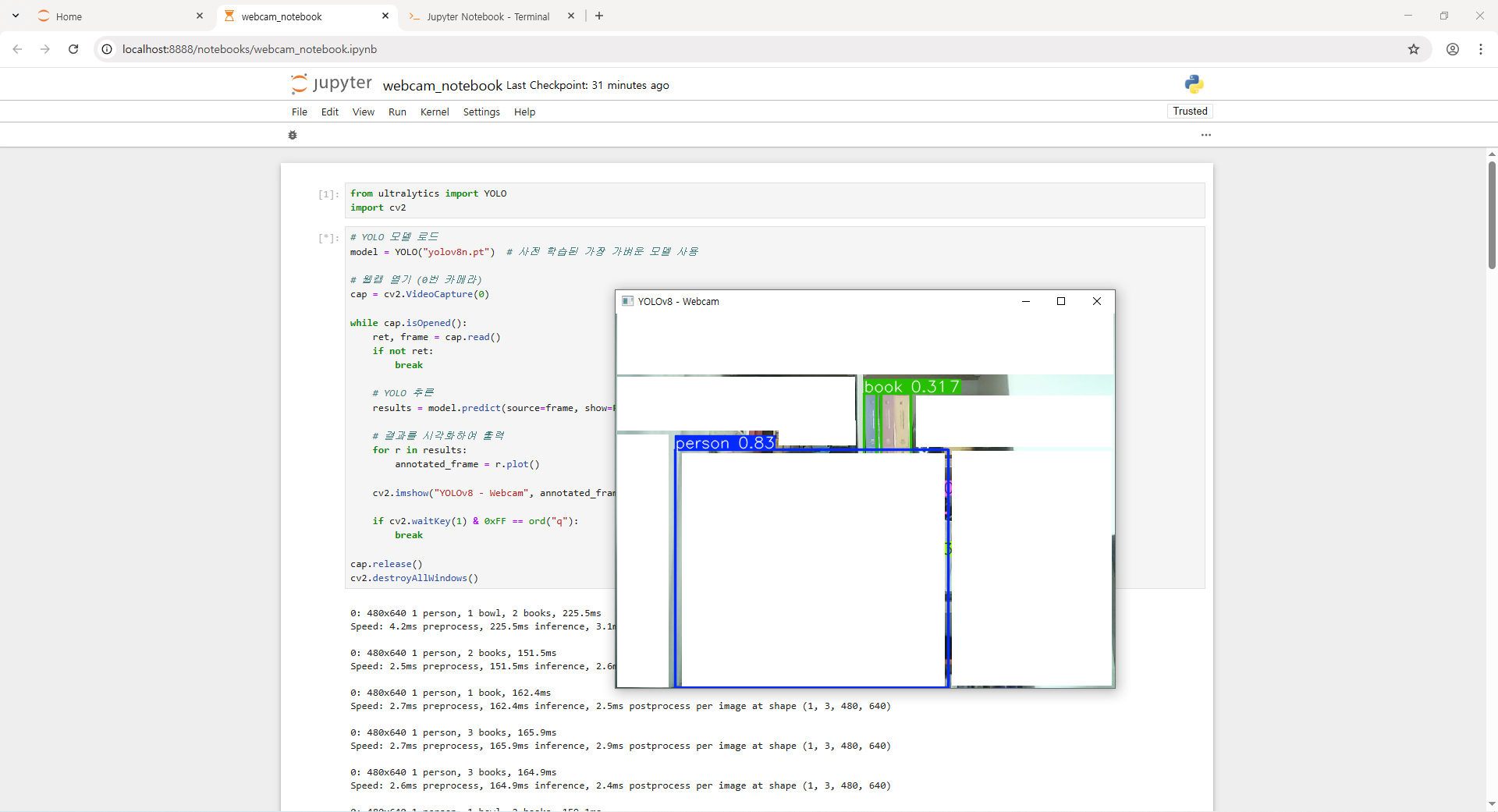

그 후 소스를 붙여넣고 수행하면 아래와 같은 객체인식 테스트 화면을 볼 수 있다.

이미지를 통해서 보는 것처럼 책은 낮은 확률(0.317)로..

그리고 웹캠을 보고 있는 필자는 0.83의 확률로 person으로 인식하는 것을 볼 수 있다.

끝.

'IT기술 연구소' 카테고리의 다른 글

| 구글 AI 스튜디오로 AI와 대화 하면서 문제를 해결해 보기 (0) | 2025.07.04 |

|---|---|

| Visual Studio Code, Python을 이용한 Yolo 객체 인식 (0) | 2025.04.12 |

| java.net.SocketTimeoutException: Read timed out (Jsoup) (0) | 2024.07.09 |

| 챗GPT로 초등학생 아이의 수학 문제를 풀어보았다. (0) | 2023.12.16 |

| 운송장 번호 채번에 대한 고찰 (1) | 2023.12.16 |